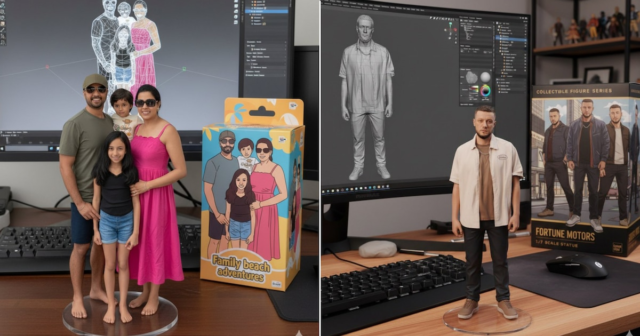

Miles de personas compartieron su Estadísticas de acción digital Géminis 2.5 Hecho de fotos individuales de Flash – quien también se identifica Banona-, nueva inteligencia artificial Google Centrado en la generación salarial de imágenes.

Esta tendencia ha creado un evento para convertir la identidad de los usuarios en la identidad de los usuarios en los objetos de recolección virtual de Burgets, pero la última experiencia de técnicas similares advierte los resultados que pueden afectar los resultados. Soporte de privacidad, protección de datos e identificación.

Hay otros casos de símbolos en los que el uso más dañino de las técnicas de procesamiento de imágenes y la validez facial se ve comprometida con millones de personas. Fue uno de ellos ClearView A.I.Una compañía que ha trabajado como motor de búsqueda de facilidad desde 2020, como un motor de búsqueda tradicional, pero especializado en identificar a las personas con fotografías. Cliervue recopiló datos de plataforma abierta como red social, páginas y blogs de revistas e integró el compatibilidad con información biométrica establecida.

En 2022, la compañía enfrentó una demanda Unión Americana de Libertades Civiles (ACLU) En EE.UUComo resultado, no hay entidades propiedad del gobierno en el mercado para el software Ftware en el mercado. Aunque mantiene su desempeño, el uso de datos confidenciales sin el claro consentimiento de las personas afectadas por la empresa salarial no pudo esquivar disputas legales y sanciones económicas en diferentes países debido al uso de datos confidenciales.

Otra muestra significativa fue un evento registrado GritarDedicado a los sistemas de reconocimiento facial utilizados en un espacio de vida nocturna australiano de Strallian Company. En mayo de 2024, se informó Una fuga de inteligenciaDe los cuales se encontraban los datos biométricos de 19 máquinas tragamonedas de clubes ubicadas en el territorio del reconocimiento facial, identidad escaneada, firmas, membresía, casas, fecha de nacimiento, números de teléfono, Newwa Gales Del Sur y Australian Strallian Capital.

Según aquellos que trabajaron como desarrolladores en el oxc CUS, la información filtrada fue acreditada por un sitio web que demostró lo no autorizado de los datos. Puretor de operador Clubssw Contrató servicios de Outb Ox QS y obtuvo una cantidad significativa de distancia de seguridad sin un consentimiento claro sobre el cliente de los clientes directamente o el destino de su información personal.

En el pasado no había ansiedad sola. En 2025, muchos usuarios recurrieron a la plataforma Charlar Y para crear sus propias imágenes en otras Estudio de animación Gibli Gibli. Subieron retratos individuales que fueron directamente a los modelos de la nueva generación de pago de Delo.

Esta práctica, a pesar de la trivialidad, revela el problema central en los servicios actuales basados en la inteligencia artificial: se requieren estas tecnologías Una gran cantidad de datos personales, sensibles y secretosSe obtienen métodos donde el alcance real de la coordinación no se explica casi claramente.

Esta información no solo facilita posibles fugas y robos realizados por el delito cibernético, sino que también aumenta La probabilidad de identificación y fraude digitalPorque el contenido fue proporcionado voluntariamente por los usuarios. La ausencia de fuertes restricciones en el almacenamiento y el proceso seguro de estos datos, como la evidencia en el episodio Outb Ox Q, extiende los ataques y las oportunidades de violaciones.

Además, una gran cantidad de recopilación de datos generalmente se realiza sin Consentimiento informado Usuarios. En muchos casos, aquellos que eligen estos servicios ignoran el objetivo final de sus fotos y datos personales y serán reutilizados, almacenados indefinidamente o serán transferidos a terceros. Desde un punto de vista legal, es un defecto grave en el consentimiento de la visión y crea los propósitos para el opaco para el cual funcionan estos datos.

Finalmente, falta Transparencia y explicar en algoritmos y políticas de privacidad Causa fricción con las reglas locales e internacionales. Algunas compañías dicen a través de secciones claras que las imágenes se utilizarán para mejorar sus modelos de IA, pero la complejidad y la duración de los documentos de privacidad coloca a los usuarios en una situación en la que apenas pueden comprender el alcance real de la transferencia de derechos en sus propios datos.